Без тестирования один неудачный заголовок или неправильно подобранный креатив может стоить вам десятков тысяч рублей слитого бюджета. Рассказываем, как правильно выполнять A/B-тесты в рекламных кампаниях: какие инструменты использовать, что анализировать и как избежать распространенных ошибок.

Что такое A/B-тестирование

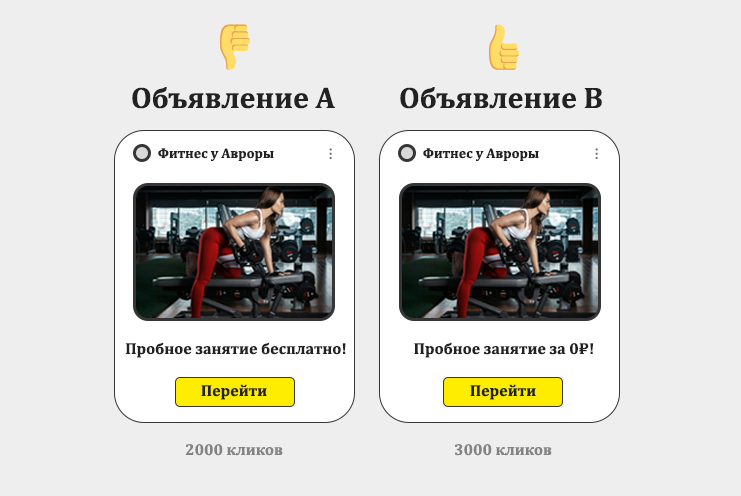

A/B-тестирование (AB testing) в маркетинге — это метод сравнения двух или более вариантов одного элемента рекламы. Оно позволяет понять, какой из них лучше работает на улучшение ключевой метрики: конверсии, продажи, прибыль.

В чем преимущество:

- С помощью такого тестирования каждая рекламная кампания превращается в управляемый эксперимент.

- Вместо того чтобы менять всё разом и надеяться на лучшее, вы тестируете изменения по одному.

- Вы точно знаете, что именно повлияло на результат.

Из подхода «пальцем в небо» оптимизация рекламных кампаний переходит на новый уровень с подтверждением статистикой.

4 ключевых цели A/B-экспериментов, они же — метрики

Зачем нужно проводить тесты в Яндекс Директ, Google Ads, VK Рекламе и других маркетинговых каналах? Ответ прост — ради измеримого улучшения ключевых показателей:

1. Рост конверсий (CR)

Даже небольшое изменение заголовка или призыва к действию может увеличить количество заявок на 15-25%.

2. Снижение стоимости привлечения клиента (CPA)

Когда объявление получает больше кликов и конверсий при том же бюджете, стоимость каждого лида автоматически падает.

3. Повышение показателя кликабельности (CTR)

Тестирование заголовков и креативов стабильно даёт прирост CTR на 10–30%. А более высокий CTR — это ещё и улучшение показателя качества объявлений, что снижает стоимость клика в аукционе.

4. Увеличение показателя возврата на рекламные расходы (ROAS)

Когда каждый элемент рекламной воронки оптимизирован через тестирования, общая отдача от вложений в рекламу растёт кратно.

Чаще всего маркетологи выбирают одну метрику и ориентируются на нее. Также можно анализировать дополнительные показатели: отказы, время на сайте, глубина просмотра, качество лидов, процент продаж или заказов, маржа и доходность и т. д.

Методы тестирования в рекламе: какой выбрать

При тестировании рекламных кампаний не ограничивайтесь классическим сравнением двух вариантов заголовков или картинок. Существует несколько методов:

| Метод | Описание | Когда использовать |

|---|---|---|

| Одноэлементное | Сравниваются два варианта элемента. Например, заголовок против заголовка. | На старте, когда нужно определить базовые элементы, которые влияют на эффективность. |

| Многоэлементное | Одновременный тест нескольких элементов в связке.Например: креатив + заголовок. | Если есть достаточный объём трафика и нужно быстро определить лучшую комбинацию. Минус — сложно понять, какой именно элемент повлиял. |

| Многовариантное (A/B/n) | Тестирование трёх и более вариантов одновременно. | При большом трафике — от 10 000 показов в день. Если у вас менее 5 000 показов, лучше остановиться на классическом A/B-тесте. |

| Сплит-тестирование по аудиториям | Одно и то же объявление показывается разным сегментам аудитории (по полу, возрасту, географии, интересам) для определения наиболее отзывчивого сегмента. | Для оптимизации таргетинга и распределения бюджета между аудиториями. |

Какие элементы можно тестировать с помощью A/B-экспериментов

В экспериментах с проверкой гипотез в контекстной рекламе желательно придерживаться устоявшихся правил. Давайте рассмотрим, какие триггеры, условия и изменения можно вносить в заголовки, креативы и форматы.

Заголовки

Заголовок — это первое, что видит пользователь, поэтому A/B-тестирование его вариаций считается самым быстрым способом улучшить рекламные кампании.

Что тестировать:

- Эмоциональные призывы против рациональных. Например: «Устали от холода в квартире? Мы решим это за 1 день!» и «Утепление квартиры: снижение теплопотерь на 40%».

- С цифрами и без. Например: «Ремонт за 30 дней с гарантией 5 лет» и «Быстрый и качественный ремонт с гарантией».

- С выгодой или характеристикой. Например: «Экономьте 30 000 ₽ в год на отоплении» и «Энергоэффективные окна класса A++».

- Вопрос или утверждение. Например: «Хотите снизить расходы на рекламу в 2 раза?» и «Снижаем расходы на рекламу в 2 раза».

Совет: маркетологи рекомендуют начинать с тестов над заголовками. Это самый простой элемент для изменения и тот, который сильнее влияет на исход.

Креативы

Визуальная составляющая объявления — второй по важности элемент после заголовка. Тестирование креативов помогает определить, какой формат и стиль изображения лучше всего откликается у аудитории.

Что тестировать:

- Фото против видео. Видео в среднем увеличивает вовлечённость на 20-30% по сравнению со статичными изображениями. Подходит не везде.

- Статичные и динамичные форматы. Статичное — простое, быстро загружается, работает везде. Динамический баннер — привлекает больше внимания, но может раздражать. Карусель — позволяет показать несколько товаров или преимуществ.

- Форматы и пропорции. Квадрат 1:1 — универсальный формат, работает в лентах и на площадках РСЯ. Горизонтальный 16:9 — для десктопных размещений, а для мобильных — вертикальный 9:16.

- Содержание креатива. Например: фото человека с продуктом против фото продукта крупным планом. Или белый фон против яркого цветного и т. д.

Тестируйте кардинально разные подходы, а не мелкие вариации. Разница между красной и синей кнопкой редко даёт значимый результат.

Не забывайте про мобильные устройства. Более 70% трафика идёт с мобильных. Убедитесь, что креатив читается на маленьком экране.

Карточки товаров

Тесты карточек — важный элемент оптимизации для интернет-магазинов.

Что тестировать:

- Основное изображение товара на белом фоне или в интерьере.

- Заголовок карточки. Например, название товара и название + ключевая выгода.

- Цена: показывать старую цену зачёркнутой или нет.

- Описание: короткое или подробное.

Объявления

A/B-тестирование объявлений в Яндекс Директе предполагает сравнение полных версий объявлений, включая все элементы.

Какие вариации в тестировании можно пробовать:

- Текст + изображение или только текст.

- Формулировки быстрых ссылок. «Каталог» против «Смотреть все модели».

- Уточнения. Добавьте уточнения с конкретными преимуществами: «Бесплатная доставка», «Гарантия 3 года», «Монтаж за 1 день».

- Отображаемая ссылка. «site.ru/акция» или «site.ru/скидки-50» — пользователь видит это в объявлении, и разные формулировки влияют на CTR.

Стратегии ставок

Одно из самых результативных направлений тестирования.

Что тестировать:

- Ручное управление ставками против автостратегий (там, где они доступны).

- «Максимум кликов» против «Максимум конверсий».

- Разные цели.

Ручной подход дает полный контроль на старте, когда данных мало, но автостратегии лучше работают после накопления статистики.

Минус-слова

Создайте две кампании: с текущим набором минус-слов и с расширенным списком. Сравните CTR, конверсию и качество трафика. Часто расширение списка минус-слов снижает общее количество кликов, но повышает конверсию и снижает CPA.

Посадочные страницы

Направляйте трафик из двух кампаний на разные версии лендинга. Один лендинг — с длинной формой заявки, второй — с короткой. Или с видео и без. Сюда же можно отнести технические условия, например оптимизацию скорости загрузки страниц.

Этапы A/B-тестирования: полный гид по проведению

Перед тем как проводить A/B-тестирование, подготовьтесь. Ваша задача — не просто получить достоверную статистику, а грамотно настроить тест на каждом из этапов.

Этап 1. Подготовка

1. Определяем цели и гипотезы:

- Пропишите план эксперимента и четко поставьте цель, к чему вы стремитесь: снизить цену за конверсию, увеличить количество лидов и т. д.

- Выберите одну конкретную гипотезу для теста: например, стратегию ставок или изменение креатива. Гипотеза может выглядеть так: «Если мы добавим видео вместо статичного изображения в объявление, конверсия увеличится на 20%, потому что видео лучше демонстрирует продукт».

2. Выбираем инструменты для анализа:

- Счетчик Яндекс Метрики или Google Analytics на сайте для анализа с настроенными целями.

- Калькулятор достоверности для проверки статистической значимости (клики, конверсии, расходы). Например, в Яндексе.

3. Подготавливаем рекламные кампании:

- Если тестирование на уровне разных рекламных кампаний: исходная (базовая) рекламная кампания должна быть с историей данных. Её копии для вариантов A и B (приостановить оригинал).

- Если хотим провести эксперимент на уровне объявлений: в одной — контроль (без изменений), во второй — тестируемое изменение, например, заголовок, описание или изображение.

- Накопите достаточно данных. Например, в Яндекс Директе это не менее ~200 конверсий за месяц.

- Чтобы автостратегии работали, на каждую тестируемую кампанию нужно достаточно конверсий: минимум 10 на одну ежедневно. Учитывайте это при запусках.

4. Выделяем дополнительные ресурсы:

- Бюджет на тест — равномерный.

- Команда или специалист для мониторинга.

Этап 2. Распределение трафика

Разделение трафика — критически важный шаг, от которого зависит достоверность всего эксперимента. Следуем четким правилам разделения ЦА:

- Пропорция 50/50. Обе версии должны получать равное количество трафика. Если вариант A показывается 80% аудитории, а B — только 20%, то результаты будут искажены. Если три, то, соответственно, распределяем по 33/33/34. Допустимо неравномерное распределение, но только если хочется потестировать изменение на узкой группе пользователей.

- Минимальный объём выборки. Для получения статистически значимых данных необходимо не менее 1000 показов на каждый вариант и ~200 конверсий, как мы указали выше.

- Рандомизация. Аудитория должна распределяться случайным образом. Нельзя показывать объявление A только мужчинам, а B — только женщинам, иначе это будет уже другой тип тестирования.

- Идентичные условия. Соблюдайте одно время, показы на одинаковых площадках и одной аудитории. Если вы запустите объявление A в понедельник, а B в пятницу, статистика будет несопоставима.

После подготовки гипотез, целей и аудитории можно перейти к запуску.

Этап 3. Запуск теста

Чтобы было проще следовать алгоритму, сверяемся с чек-листом:

- Гипотеза сформулирована и записана.

- Определена ключевая метрика: 1 основная + 2-3 дополнительных.

- Создана точная копия контрольного варианта с одним изменённым элементом.

- Настроено отслеживание целей в аналитике (Яндекс.Метрика, Google Analytics).

- Трафик разделён корректно (50/50).

- Определена продолжительность теста.

- Убедились, что на результаты не влияют внешние факторы (праздники, распродажи, сезонность).

После подготовки и проверки можно перейти к настройке тестов в инструментах:

- В Яндекс Директе эксперименты доступны в разделе «Библиотека» → «A/B-эксперименты» (ранее были в Яндекс Аудиториях):

- В Google Ads — «Эксперименты»:

- Вариокуб в Яндекс Метрике — для проверки гипотез по изменениям на сайте:

Что делать во время теста:

- Тестируйте одну гипотезу за раз.

- Не вносите изменения в тестируемые варианты.

- Мониторьте технические ошибки (битые ссылки, пропавшие изображения).

- Следите за равномерностью распределения трафика.

- Фиксируйте внешние факторы, которые могут повлиять на результаты. Например, заявления Роскомнадзора о запрете рекламы в некоторых каналах.

Следите за метриками в режиме реального времени. Обращайте внимание на внезапные скачки стоимости клика (CPC) или резкое снижение количества конверсий. Возможно, в тестирование вмешалась третья сторона. К примеру, боты на каком-нибудь «мусорном» сайте.

Этап 4. Анализ результатов

Анализ полученных данных после A/B-тестирования — этап, на котором вы анализируете статистику. На основе полученных данных будет принято решение: внедрять изменения или нет.

В дело вступает расчет статистической значимости:

Для определения значимости используется t-тест. Ключевой показатель — p-value.

P-value в A/B-тестировании рекламы оценивает вероятность, насколько случайны полученные результаты. Выражается от 0 до 1. Меньшее значение, например, 0,05 (95% уверенности), указывает на высокую вероятность статистической значимости — разница не случайна. Классический процент в калькуляторе Яндекса — 80% — считается оптимальным.

Как интерпретировать:

- от 0,01 до 0,05 — значимый результат, внедряем.

- от 0,05 до 0,10 — пограничный, доп. тест.

- выше 0,10 — отклоняем.

Сколько времени потребуется на проведение A/B-тестирования

Оптимальная продолжительность — от 7 до 14 дней. Это минимальный срок, который позволяет:

- набрать достаточный объём данных,

- учесть разницу в поведении пользователей в будни и выходные,

- исключить влияние кратковременных изменений трафика.

Не останавливайте тест раньше запланированного срока, даже если один из вариантов уже показывает лучшие результаты. Ранняя остановка — одна из самых распространённых ошибок, которая приводит к ложноположительному итогу.

Типичные ошибки A/B-тестирования, которые приводят к ненадежным результатам

Ошибка 1. Мало трафика

Если на каждый вариант приходится менее 500-1000 кликов, то на полученные результаты нельзя будет полагаться. Вы можете получить разницу, которая окажется простым статистическим шумом.

Чтобы этого избежать, рассчитайте необходимый объём выборки до запуска. Если трафика не хватает — увеличьте срок или бюджет.

Ошибка 2. Преждевременная остановка тестирования

Если вы видите, что вариант А опережает уже на третий день своего «оппонента», не останавливайте тест. На малых выборках статистика нестабильна — через неделю разница может исчезнуть или даже развернуться в обратную сторону.

Лучше определите срок заранее (минимум 7 дней) и не останавливайтесь раньше, каким бы заманчивым ни казался промежуточный результат.

Ошибка 3. Влияние сезонности

Тест, проведённый в период «Чёрной пятницы», праздников или начала сезона, даст искажённую статистику. Поведение аудитории в эти периоды отличается от обычного.

Запускайте эксперименты в «нормальные» периоды. Если они попадают на сезонный пик — учтите это при анализе.

Ошибка 4. Тестирование нескольких элементов одновременно

Вы одновременно меняете заголовок, изображение и текст. Результат улучшился — но какой элемент сработал? Неизвестно.

Меняйте только один элемент за раз. Исключение — осознанный многоэлементный тест с достаточным трафиком.

Ошибка 5. Игнорирование сегментов

Общий итог тестирования может скрывать разницу по сегментам. Например, вариант B может работать лучше для мобильных пользователей, но хуже — для десктопных.

Анализируйте полученные данные не только в целом, но и в разрезе устройств, географии, времени суток.

Ошибка 6. Выбрана некорректная метрика

Если вы проигнорируете реальные бизнес-цели и будете смотреть только клики или только просмотры, то упустите снижение других показателей. Например, квалифицированных лидов.

В первую очередь ориентируйтесь на метрику, которая отражает ценность именно для вас и вашего бизнеса. Например, маржа.

Ошибка 7. Не учтен фрод, бот-трафик и фальшивые конверсии

Отдельная серьёзная проблема — фрод. Бот-трафик и скликивание могут искажать результаты тестирования до неузнаваемости.

Проблема:

- Кликабельность может быть высокой, но с нулевой конверсией.

- Или конверсия может быть достаточной, но фальшивой — спам-заявки от ботов, которые не приводят к продажам.

Данные по результатам будут выстраиваться на недействительной статистике. В дальнейшем это приведет к усугублению проблемы, потере связи с реальной аудиторией и еще большему сливу рекламного бюджета.

Как сохранить чистоту эксперимента

- Анализируйте качество трафика до начала теста — если есть проблемы с фродом, сначала решите их.

- Если размещаетесь на площадках РСЯ, КМС, отследите качество трафика и ключевые метрики на них. В первую очередь обращайте внимание на мобильные приложения с высоким показателем отказов, низкой стоимостью клика и высоким CTR.

- Используйте дополнительные антифрод-инструменты: Защита Яндекс Директ, Защита Google Ads, Защита VK Реклама, Умная капча, Медиа Таргет.

A/B-тестирование — это не волшебная кнопка, а системный процесс оптимизации рекламы. Каждый проведённый тест — шаг к лучшему пониманию вашей аудитории и более эффективному расходованию бюджета.

Ответы на популярные вопросы (FAQ)

Подписывайтесь на наш канал в Telegram: рассказываем про реальные истории угроз, наши инструменты, факты о мошенничестве с рекламой и не только.