До половины трафика на вашем сайте — не люди. Это боты, краулеры и ИИ-агенты, которые заходят на страницы с самыми разными целями: от безобидной индексации до целенаправленных накруток со стороны конкурентов.

В этом пошаговом руководстве мы разберём, какие типы ботов в 2026 атакуют сайты, чем они опасны и как от них защититься — от бесплатных методов до продвинутых антифрод-решений.

Бот-трафик в России и в мире

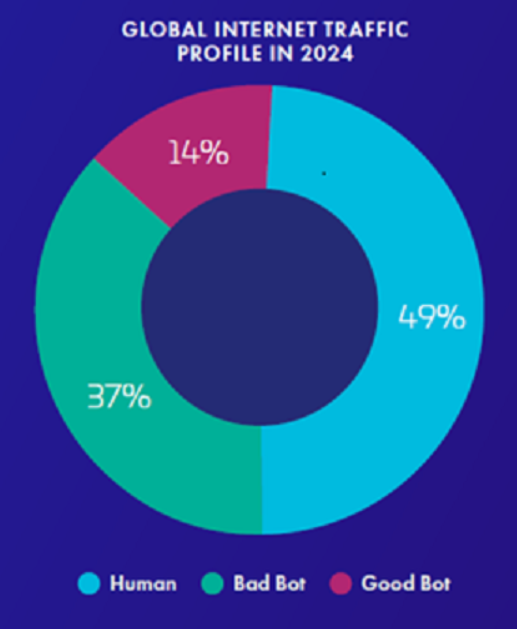

По данным отчёта Imperva Bad Bot Report 2025, доля автоматизированного трафика в мировом интернете впервые превысила 50%, при этом объем вредоносных ботов достиг рекордных 37%. Человеческий трафик оказался в меньшинстве.

Диаграмма показывает распределение веб-трафика в 2024 году: 49% — люди, 37% — вредоносные боты, 14% — полезные роботы.

В России ситуация схожая. По данным экспертов StormWall, в 2025 году объём бот-трафика в российском сегменте интернета вырос минимум в 1,7 раз. Появились «зондирующие DDoS-атаки», когда злоумышленники всего за 15 минут анализируют инфраструктуру и выбирают конкретную уязвимость для последующей полномасштабной атаки.

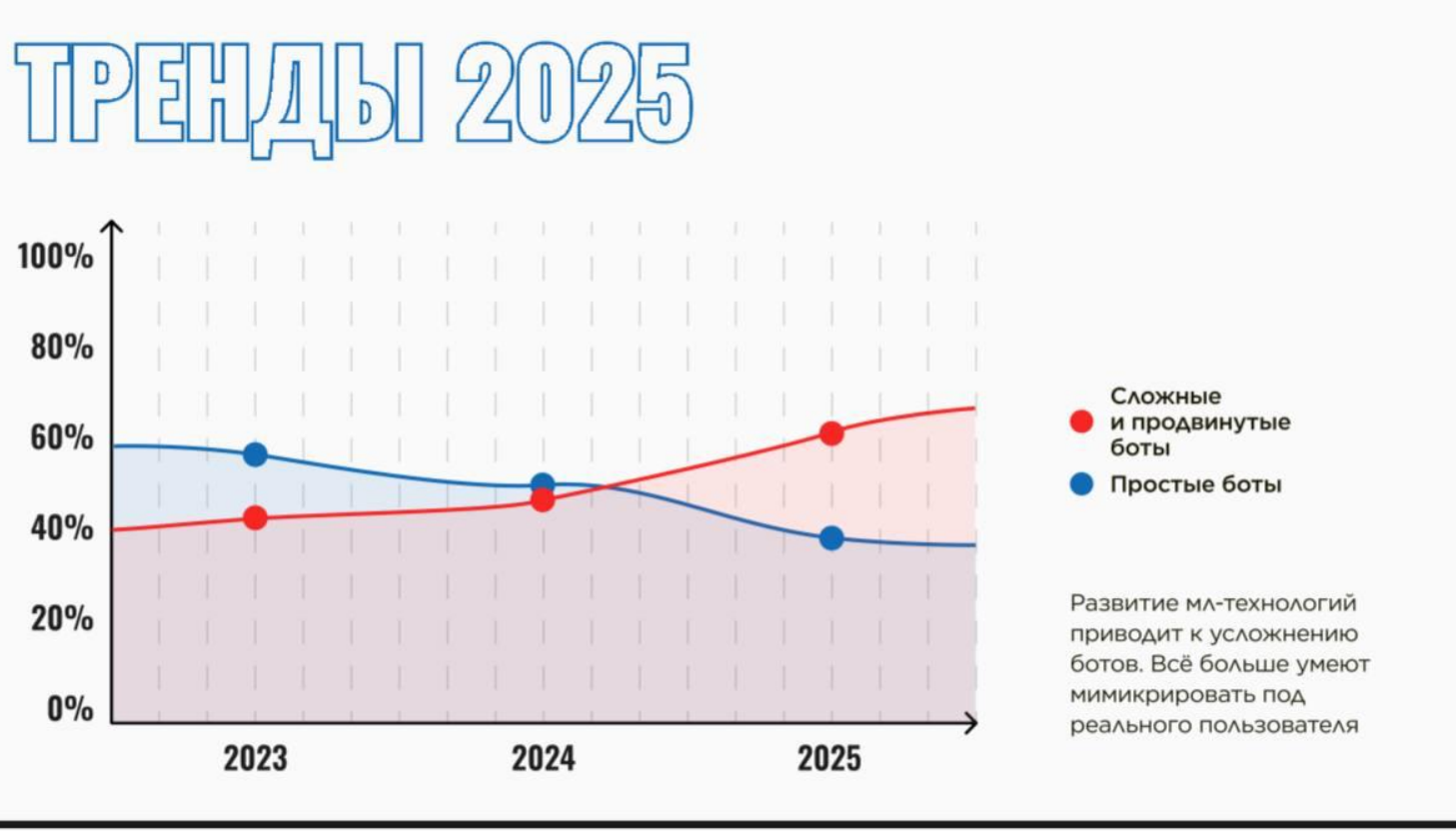

Отдельный тренд 2024-2025 годов — взрывной рост вредоносных ИИ-ботов. По оценкам «Ботфактор» и данным исследований рынка, боты становятся умнее и сложнее. Если в 2023 они были в меньшинстве (~40%) по сравнению с примитивными скриптами, то в 2025 ландшафт изменился. Теперь сложные и продвинутые боты, то есть те, которые работают на ИИ и машинном обучении, составляют 60%.

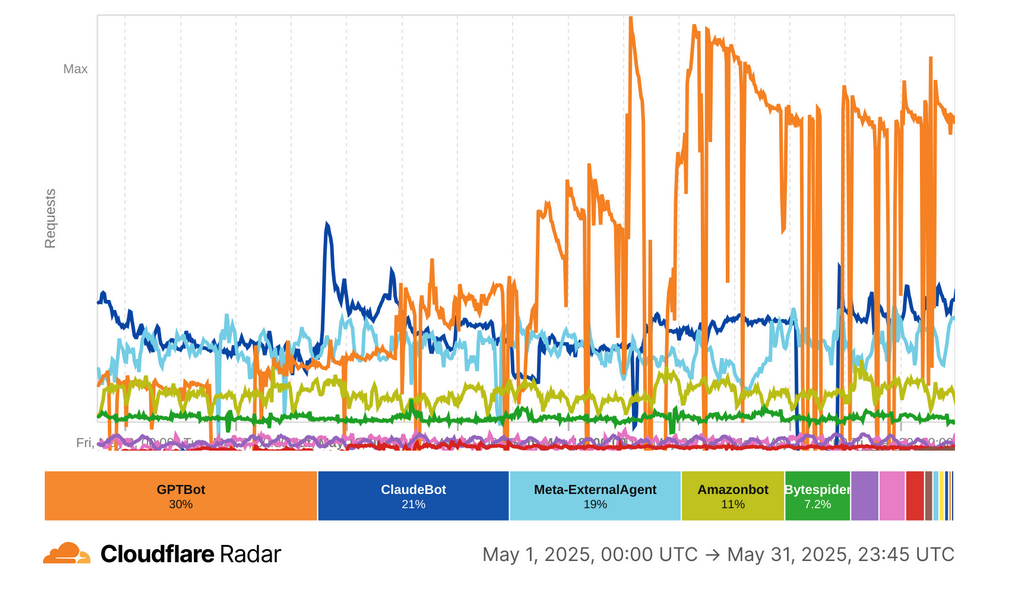

По данным Cloudflare Radar, в 2025 году трафик от ботов ChatGPT, Perplexity и аналогичных сервисов (без учета поисковых краулеров) вырос в несколько раз по сравнению с 2024 годом.

Для бизнеса это означает конкретные потери: искажённая аналитика, SEO-пессимизация, нагрузка на инфраструктуру, «слив» рекламного бюджета. Но всё зависит от типов ботов, которые к вам пришли, и усилий, которые вы готовы приложить для защиты от них.

Какие типы ботов заходят на сайты в 2026 году

Прежде чем перейти к защите сайта от ботов, нужно понять, с кем вы имеете дело. Не все роботы одинаково вредны или полезны — некоторые необходимы для работы вашего сайта, другие — топят его в поисковой выдаче.

1. Краулеры поисковых систем

Уровень угрозы: низкий. Это «хорошие» боты. Однако при слишком частом сканировании они могут создавать нагрузку на сервер.

Что они делают. Сканируют страницы сайта для индексации в Яндекс, Google и других поисковых системах. Именно благодаря им страницы появляются в выдаче.

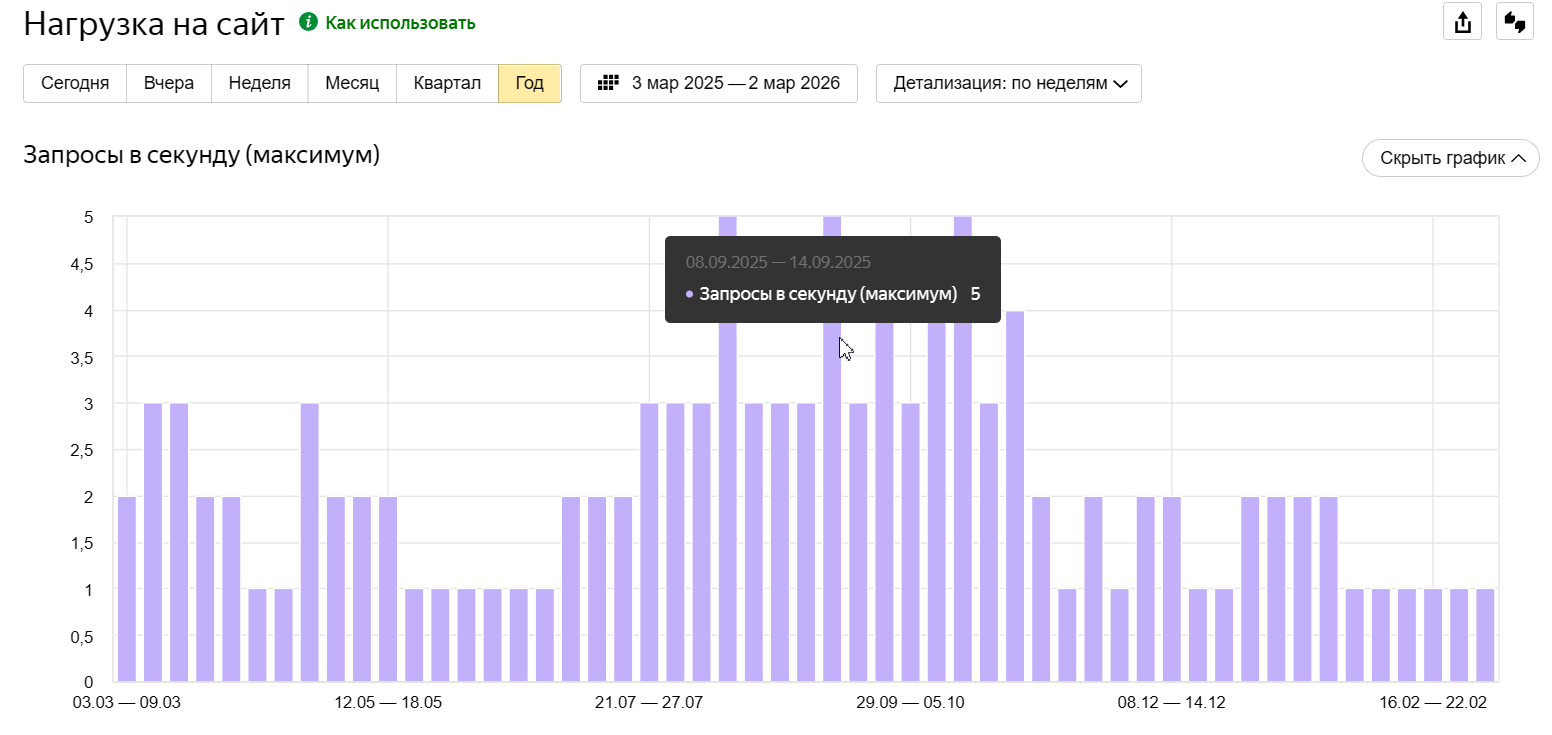

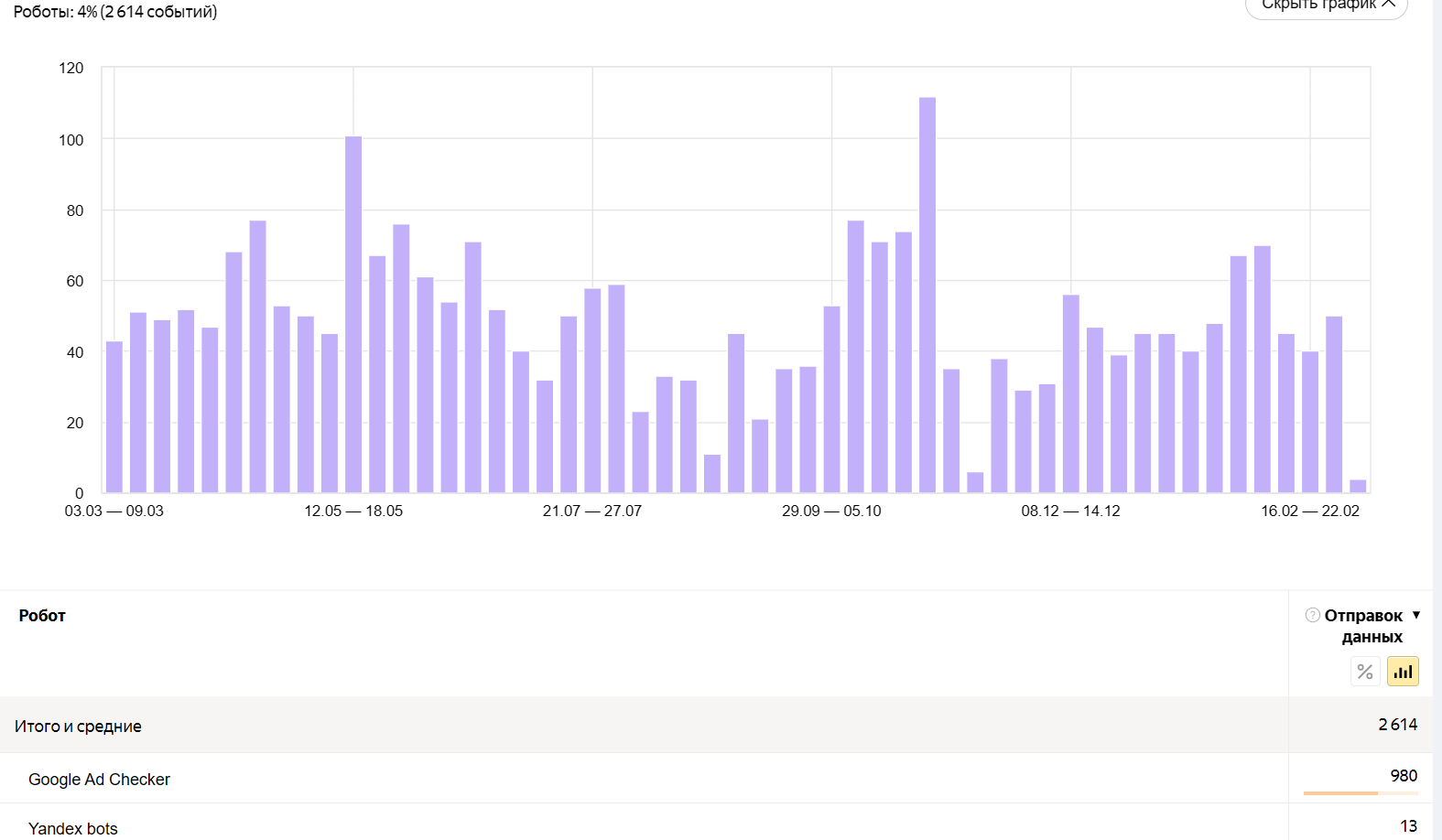

Где посмотреть. Узнать, кто из роботов поисковиков «нагружает» сайт, можно в Яндекс Метрике: Отчеты → Мониторинг → Нагрузка на сайт (когда) → Роботы (кто).

Нужно ли от них защищать сайт. Нет. Если хотите снизить нагрузку при частом и масштабном сканировании сайта, можете добавить в файл robots.txt директиву Crawl-delay. Она задает роботу минимальный период времени (в секундах) между окончанием загрузки одной страницы и началом загрузки следующей. Яндекс, Bing, Yahoo учитывают директиву, Google — нет.

2. Боты-накрутчики поведенческих факторов

Уровень угрозы: высокий. Если конкуренты накручивают ПФ на вашем сайте с негативным контекстом (короткие визиты, отказы, низкая глубина просмотров и взаимодействия с сайтом), то это может привести к просадке уже существующих позиций.

Что они делают. Боты имитируют переходы на сайт из выдачи по определенным запросам и создают видимость заинтересованности контентом. Их цель — искусственно улучшить поведенческие факторы конкурирующего сайта в глазах поисковых систем.

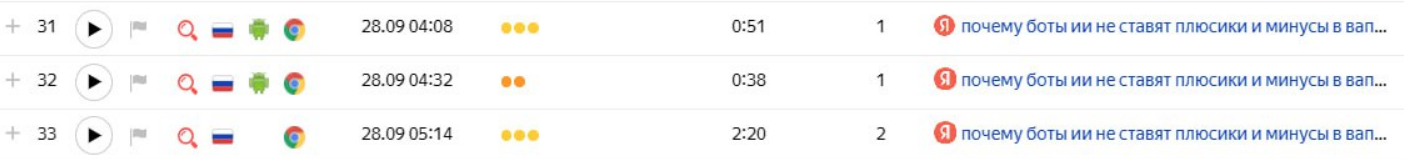

Конкурент пытается через ваш сайт «нагулять» историю визитов для ботов по определенным запросам, чтобы в дальнейшем вести их на свой сайт. Там боты не будут сразу покидать страницу — они будут просматривать контент, переходить по разделам и ссылкам, добавлять товары в корзину.

Что делать вам. Отслеживайте аномалии в трафике и обратите внимание на следующие показатели:

- резкий всплеск количества переходов под определенные запросы,

- визиты идут «кучкой»,

- запросы могут быть странные, с опечатками и операторами,

- из одного региона,

- неестественно одинаковое время на сайте,

- визиты практически без взаимодействия с контентом.

Как защитить сайт. Для защиты от таких ботов используйте антифрод-инструменты. Они подключаются к сайту и за доли секунды анализируют любые визиты — из поиска, прямые, с других ресурсов, из рекламы — по цифровому следу, техническим параметрам устройства и еще 100+ параметрам. Если система определяет визит как вредоносный, то блокирует отрисовку контента и добавляет профиль в стоп-лист.

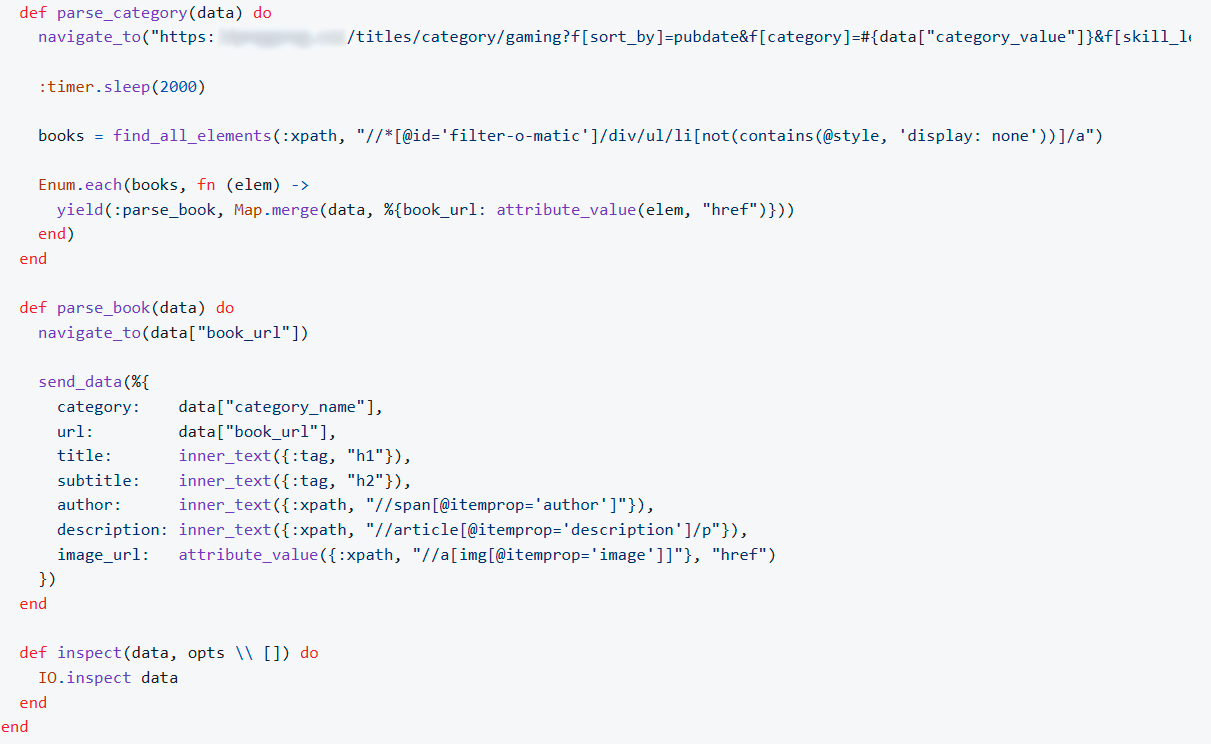

3. Парсеры и скраперы

Это программы для автоматизированного сбора данных с сайта.

Уровень угрозы: средний — высокий. Для интернет-магазинов и сервисов с уникальным контентом парсинг особенно болезнен.

Что они делают. С помощью них конкуренты и монетизаторы либо частично копируют контент (описания товаров, услуг, статьи), либо полностью клонируют сайт.

В дальнейшем этот контент оказывается на десятках чужих сайтов, а конкуренты оперативно подстраивают цены через мониторинг каталогов в реальном времени. В последнем случае — это способ выживания в высококонкурентных нишах с быстрыми продажами.

В России парсинг не запрещён, но его использование имеет некоторые ограничения: нельзя таким образом выгружать персональные данные, нарушать авторские права и использовать программы, которые обходят защиту против парсинга.

Как защититься от парсеров:

- ограничивайте частоту запросов с одного IP. Например, можно разрешить только 100 запросов в минуту с одного IP-адреса. Если лимит превышен, последующие запросы будут блокироваться или задерживаться. Настраивается на уровне веб-серверов через модули limit_req, mod_ratelimit и др.

- внедряйте динамическую генерацию контента. Например, традиционные парсеры не выполняют JavaScript и не видят такое содержимое;

- используйте решения для защиты от автоматизированного доступа. Например, Positive Technologies, Kaspersky Anti-Bot.

4. ИИ-агенты (ChatGPT, Perplexity)

Уровень угрозы: средний, но быстро растёт. ИИ-краулеры перехватывают трафик, который раньше приходил из поиска. Пользователь получает ответ прямо в чате нейросети и практически не переходит в первоисточник. Это так называемый эффект нулевого клика нового поколения.

Что они делают. Языковые модели (ChatGPT, Perplexity и другие) отправляют своих краулеров для сбора актуального контента с сайтов. Они «обучаются» на ваших текстах и выдают пользователю обобщённую информацию.

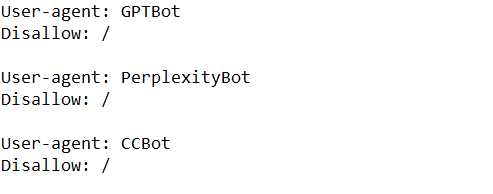

Что делать. По данным Cloudflare Radar, наиболее часто полностью блокируемыми в robots.txt ботами в 2025 году стали именно нейропоисковые агенты: GPTBot, ClaudeBot и CCBot.

Для себя вам нужно решать с точки зрения SEO-стратегии и инвестиций: хотите ли вы, чтобы ваш контент использовался ИИ-моделями — попадать в GEO и AEO выдачу. Если нет — блокируйте конкретных краулеров (GPTBot, ClaudeBot, PerplexityBot) через robots.txt. Если да — оптимизируйте контент для ИИ-выдачи и следите за упоминаниями бренда.

Примеры блокировок в robots:

Ранее в нашем блоге мы писали об этой дилемме: с одной стороны, нейросети помогают пользователям быстро находить ответы на свои вопросы, а сайты могут в них продвигаться и приводить хоть какой-то трафик, с другой — бизнес недоволен тем, что контент, в который он инвестирует, бесплатно забирают нейросети.

5. ИИ-боты (вредоносные)

Стоит отличать ИИ-агентов от их вредоносных аналогов. Боты, используемые злоумышленниками для атак на сайты и рекламу, представляют собой автономные или полуавтономные агенты на базе искусственного интеллекта.

Уровень угрозы: высокий. Они эволюционируют быстрее традиционных ботов благодаря машинному обучению, внедрению цифровых следов и технической поддержке каждого профиля.

Что они делают. Выполняют DDoS-атаки, распространяют вредоносный код через уязвимости сайтов, решают капчи, скликивают рекламу и накручивают ПФ, используются в фишинге и социальной инженерии, манипулируют ИИ на сайте, раскрывая данные обучения или генерируя галлюцинации для дезинформации.

Как защитить сайт. Зависит от ваших целей и точек доступа:

- Подключите Антибот с поведенческим и техническим анализом профиля каждого посетителя, если это не DDoS или парсинг. Инструмент защищает от умных ботов, которые имитируют человеческое поведение и выдают трафик за реальный. В первую очередь за счет анализа цифрового следа.

- Фаервол веб-приложений (WAF) с ИИ для выявления аномалий для более масштабных атак с потоковыми запросами.

- Многоуровневая фильтрация: CDN (российские аналоги), DPI, прокси-обход, мониторинг трафика на ИИ-сигнатуры.

6. Лид-боты

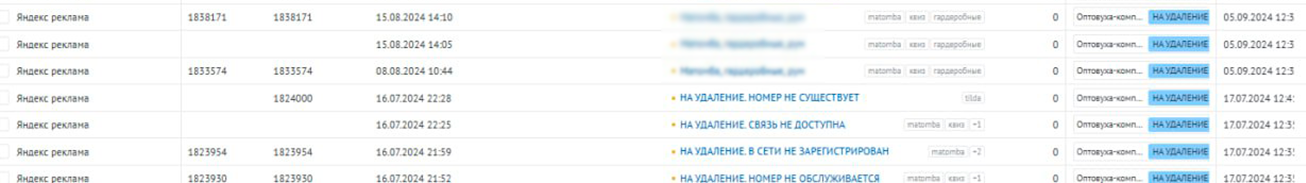

Уровень угрозы: высокий. Это боты, которые переходят по рекламе в Яндекс Директ, VK Ads, Google Ads и оставляют на сайте фальшивые заявки или выполняют другие конверсионные действия. Рекламодатели оплачивают искусственные конверсии, которые в итоге не приводят к продажам.

Что делают. Автоматически заполняют формы на сайте: заявки, формы обратной связи, регистрации. Цель — рассылка спама, искусственное увеличение выплат в пользу площадки (если бот перешел с РСЯ, КМС, РС VK), перегрузка отдела продаж ложными лидами.

Как защитить сайт. Установите поведенческую Умную капчу, Яндекс СмартКапчу или Google reCpatcha v3, добавьте скрытые поля-ловушки (honeypot) к формам, внедрите валидацию данных на стороне сервера, внедрите двойную аутентификацию или верификацию, если есть необходимость.

7. Высокоточные DDoS-боты

Уровень угрозы: критический. Если сайт «лежит» — вы теряете всё: продажи, рекламный бюджет, доверие клиентов. Рекламные кампании, выдача, внешние ссылки, соцсети и медиа продолжают работать и приводить посетителей на недоступный сайт.

Что они делают. Генерируют огромное количество запросов к серверу, чтобы вывести сайт из строя. Их преимущество — большое количество зараженных устройств в составе «армии» и имитация поведения пользователей. Например, у ботнета AISURU было обнаружено до 4 млн устройств, используемых для атак.

Что делать и как защитить свой ресурс. Используйте сервисы DDoS Guard, Qrator, StromWall и другие, настройте защиту на уровне хостинга и мониторьте доступность сайта в режиме реального времени. При обнаружении атаки автоматически останавливайте рекламные кампании.

Сравнительная таблица по типам ботов

Чтобы вам было проще ориентироваться, мы составили сравнительную таблицу по различным роботам, которые могут посещать сайты, и их особенностям.

| Тип бота | Уровень угрозы | Основные действия | Методы обнаружения | Способы защиты |

| Краулеры поисковых систем | Низкий | Сканируют страницы для индексации в поисковиках (Яндекс, Google) | Яндекс Метрика: Отчёты → Мониторинг → Нагрузка на сайт → Роботы | Нет необходимости. Для снижения нагрузки — Crawl-delay в robots.txt. |

| Боты-накрутчики ПФ | Высокий | Имитируют переходы из поиска, создают негативные/положительные поведенческие факторы | Аномалии: всплески трафика, кучные визиты, одинаковое время, отсутствие взаимодействий | Антифрод-инструменты для анализа 100+ параметров визитов и блокировок |

| Парсеры и скраперы | Средний-высокий | Собирают или копируют контент, мониторят цены | Высокая частота запросов с IP, отсутствие JS-выполнения | Ограничение запросов по IP (limit_req), динамический JS-контент, сервисы против парсинга |

| ИИ-агенты (ChatGPT, Perplexity) | Средний (растущий) | Собирают контент для обучения моделей и формирования ответа в нейровыдаче | Отчеты аналитики | Блокировка в robots.txt (GPTBot, ClaudeBot). Или оптимизация для AEO, GEO. |

| Вредоносные ИИ-боты | Высокий | DDoS, фишинг, скликивание рекламы, манипуляции контентом | Аномалии в поведении, ИИ-сигнатуры в трафике | Антибот с анализом цифрового следа, WAF с ИИ, многоуровневая фильтрация |

| Лид-боты | Высокий | Заполняют формы заявок на сайте | Фальшивые конверсии без продаж, спам в формах | Умная капча, Яндекс, reCAPTCHA v3, honeypot-поля, серверная валидация, двойная аутентификация |

| Высокоточные DDoS-боты | Критический | Атакуют сервер запросами с имитацией пользователей | Падение доступности сайта, мониторинг трафика | CDN, защита хостинга |

Пошаговый план защиты от ПФ-накруток, скликивания и прямых заходов

Чтобы защитить сайт от ботов, недостаточно разовых действий. Нужна система последовательных мер.

Мы разбили план на три уровня: аудит, базовая защита и продвинутые решения. Начинайте с первого и двигайтесь дальше в зависимости от масштаба проблемы.

Шаг 1. Аудит сайта — выявляем уязвимости

Прежде чем лечить, нужно поставить диагноз. Аудит покажет, какие боты уже заходят на ваш сайт, откуда приходят и какой ущерб наносят.

Что анализировать:

- Серверные логи. В логах видны все запросы к серверу: IP-адреса, User-Agent, частота обращений, запрашиваемые страницы. Большинство ботов оставляют характерные следы — аномально высокая частота запросов, обращение к несуществующим страницам, отсутствие загрузки CSS и JavaScript.

- Данные веб-аналитики. Откройте Яндекс Метрику и посмотрите на визиты с подозрительным поведением: нулевое время на сайте, 100%-й показатель отказов из определённых источников, визиты с нетипичными разрешениями экрана или устаревшими браузерами. Переходы ИИ-агентов будут видны по отчету Отчеты → Источники → Сайты.

- Если сайт «лёг», то в данном случае аудит не требуется — поздно, нужны контрмеры.

Какие инструменты использовать:

- Яндекс Метрика + Вебвизор. Позволяет увидеть записи визитов и вручную определить подозрительное поведение.

- Серверные логи (Apache/Nginx).

- Google Analytics 4. Отслеживайте события, которые реальные пользователи не могут совершить.

Результат аудита — чёткая картина: какой процент трафика ботовый, какие типы ботов преобладают, какие страницы и рекламные кампании страдают больше всего. На основе этих данных вы сможете расставить приоритеты защиты.

Шаг 2. Базовые методы защиты — бесплатно и просто

Эти методы не требуют больших затрат, но отсекают значительную долю примитивных ботов. Начните с них — часто этого достаточно для малого и среднего бизнеса.

- Капча — проверенное решение. Она остаётся одним из самых распространённых инструментов защиты форм и ключевых действий на сайте. В 2026 году актуальны следующие решения: Яндекс СмартКапча, reCAPTCHA v3 от Google.

- Лимиты запросов. Ограничьте количество запросов с одного IP-адреса за единицу времени, как мы писали выше. Это простой, но эффективный способ остановить примитивные парсеры и ботов. Рекомендуемый стартовый лимит — не более 60 запросов в минуту с одного IP для обычных страниц и не более 5 отправок формы.

- Honeypot — скрытые поля-ловушки. Метод гениален в своей простоте. Вы добавляете в форму скрытое поле, которое невидимо для человека, но заполняется ботом автоматически. Если поле заполнено — заявка отклоняется.

- Блокировка по User-Agent и IP на уровне сервера. Составьте чёрный список и регулярно обновляйте его.

- Для ИИ-краулеров добавьте соответствующие правила в robots.txt, если требуется. Это не гарантия абсолютной защиты — не все боты соблюдают директивы.

Шаг 3. Продвинутые антибот-решения

Базовых мер недостаточно, если на сайт идёт целенаправленная атака, бюджет на рекламу значительный или бизнес работает в высококонкурентной нише. Здесь нужны более весомые решения: антифрод-сервисы с поведенческим анализом. Например:

- Антибот — для защиты от ПФ-накруток.

- Умная капча — для защиты форм от спама.

- Защита Яндекс Директ — против скликивания и слива бюджета.

Для бизнеса, который хочет развиваться, это не роскошь, а необходимость. Специализированные сервисы отслеживают каждый визит на сайт, анализируя технические и поведенческие параметры профиля за доли секунды, не замедляя загрузку. Если бот — блок, если нет — отрисовка контента.

Окупаемость таких сервисов часто наступает в первый же месяц — экономия рекламного бюджета превышает стоимость подписки.

Боты научились подделывать IP-адреса, User-Agent и даже цифровой след браузера. Но воспроизвести естественное человеческое поведение до мельчайших деталей по-прежнему сложно. Поэтому в 2026 году антифрод-сервисы — ключевой тренд защиты сайтов от накрутки ПФ и прямых заходов.

Ответы на популярные вопросы (FAQ)

Подписывайтесь на наш канал в Telegram: рассказываем про реальные истории угроз, наши инструменты, факты о мошенничестве с рекламой и не только.